3 Didaktische Ziele und Mechanismen

3.1 Was für Ziele verfolgen wir mit dem Einsatz von GenAI in der Lehre?

Bevor wir uns der konkreten Umsetzung zuwenden, müssen wir uns zunächst fragen, was wir überhaupt bezwecken: Was sind typische Probleme und was sind unsere Ziele für die konkrete Umsetzung in Lehrsituationen?

Schauen wir uns zunächst ein zentrales Problem der Lernsituation an Hochschulen an Roediger & Pyc (2012): Wir wissen, was effektive Formen der Lehre sind, diese werden jedoch häufig nicht angewendet. Studien deuten darauf hin, dass dies eher an situativen Hindernissen der Lernumgebung liegt als am Willen der Lehrenden (Henderson & Dancy, 2007).

Ein Beispiel ist die Vorlesung. Es ist gut belegt, dass diese Form des passiven Konsums eine sehr schwache Form der Wissensvermittlung ist. Man lernt nicht nichts, aber anders würde man mehr lernen. Empirisch und theoretisch ist sehr gut belegt, dass Studierende Wissen besser behalten, wenn sie dieselbe Zeit für aktives Üben, Frage-Antwort Interaktionen oder Diskussion in Kleingruppen verwenden Hake (1998).

Praktisch wird oft mit dem positiven Effekt der reinen Anwesenheit argumentiert (besser als wenn die Studierenden zu Hause Netflix schauen; wer zur Vorlesung kommt hat bessere Noten), aber diese spezielle Form der Präsenzlehre hat durch mangelnde Interaktion klare Nachteile. Der Harvard Physiker Kestin et al. (2025) fasst drei zentrale Probleme von Vorlesungen zusammen: Mangelnde Anpassung, mangelndes individuelles Feedback und mangelnde Aktivierung der Lernenden. Genauer (Kestin et al., 2025, S.2–3): “1. They move too quickly for some students and too slowly for others because the teacher controls the pace of instruction; 2. Students do not receive personalized feedback to their questions as they arise; and 3. They fail to maintain consistent student engagement.”

Warum werden trotzdem Vorlesungen sehr häufig und aktivere Lehrformen relativ selten eingesetzt (Stains et al., 2018)? Studien deuten an, dass es oft nicht am Willen der Lehrenden liegt, sondern dass situative Hindernisse eine große Rolle spielen, vor allem Zeitmangel wird sehr häufig in Umfragen genannt (Shadle et al., 2017), außerdem bremsen Faktoren wie Gruppengröße oder ein ungünstiger Setup der Räume (Henderson & Dancy, 2007). Auch erfolgt die Umsetzung oft zu optimistisch und ohne Berücksichtigung von Widerständen und Hindernissen (z.B. Anreize für Studierende, zu Gruppenübungen auch zu kommen, oder nicht lieber ihr Wochenende in Kleingruppen zu besprechen als die Übungsaufgabe), so dass z.B. mangels notwendiger Anreizsetzung die erhoffte Lernwirkung ausbleibt und schnell Frust bei der Umsetzung entsteht (Henderson & Dancy, 2007).

Wir argumentieren hier, dass GenAI helfen kann, solche situativen Barrieren zu verringern, speziell das häufig genannte Zeitproblem bei der Umsetzung effektiver Lehrmethoden (Shadle et al., 2017). Bei sorgfältiger Umsetzung könnte GenAI so als “Kraftverstärker” für Lehrkräfte dienen (Mollick & Mollick, 2023), indem es die Implementierung evidenzbasierter Lehransätze erleichtert, die sonst aufgrund von Zeit- und Arbeitsaufwand oft schwer umzusetzen sind.

Auch hier gibt es allerdings nichts umsonst: Die neuen Tools haben ihre eigenen Risiken und Nebenwirkungen und der Aufwand für Anpassung und Umsetzung darf nicht unterschätzt werden. Einfach Sprachmodelle ohne Anpassung und didaktische ‘Bremsen’ einzusetzen ist oft nicht sinnvoll. Wie wir in der weiteren Diskussion sehen werden, nehmen sonst die KI-Chatbots den Studierenden erwünschte Schwierigkeiten ab (desirable difficulties), ermuntern sie nicht dazu, selbst Informationen abzuwägen, das eigene Verständnis zu vertiefen und so den aktuellen Fähigkeitsstand aktiv zu verbessern (growth mindset) oder überfordern die kognitive Aufnahmefähigkeit der Lernenden durch Wissens-Dumps (cognitive load). Werden die Sprachmodelle nicht dazu angehalten, klar zu sagen, wenn sie zu etwas keine Informationen haben, so können sie die Lernenden durch überzeugend vorgetragene Halluzinationen oder Fehlschlüsse in die Irre führen. Um effektiv zu sein, müssen GenAI Lernhilfen insofern didaktisch gebremst, themenspezifisch angepasst und systematisch erprobt werden (Kestin et al., 2025):

"AI chatbots are generally designed to be helpful, not to promote learning. They are not trained to follow pedagogical best practices (e.g., facilitating active learning, managing cognitive load and promoting

a growth mindset) (...) . Another well-known flaw of AI tutors is their uncanny confidence when giving an incorrect answer or when marking a correct reply as incorrect [@kestin2025]."Die nächsten Abschnitte geben eine theoriegestützte Orientierung, wie solche Anpassungen erfolgen könnten und welche Mechanismen die Lernforschung als besonders effektiv herausstellt. Zunächst führen wir zur genaueren Zielbestimmung Kategorien von Wissen und Lernmethoden ein. Dann können wir im Detail diskutieren, für welche Ziele und Methodenwahl welche Art der Unterstützung geeignet ist.

3.2 Wissenstypen

Hattie (2023, S.358, 340ff.) unterscheidet drei Stufen des Lernens (s. Tabelle 3.1).

Zunächst geht es um „knowing that“, also das reine Fakten- und Begriffswissen, das erworben und dann gefestigt werden muss: Hier soll eine belastbare Wissensbasis entstehen, weshalb Lehrkräfte häufig Vorwissensaktivierung oder Drill-and-Practice einsetzen und durch unmittelbares Feedback die korrekte Erinnerung verankern.

Darauf baut „knowing how“ auf, das prozedurale und strategische Können. Auch hier müssen Abläufe zunächst erworben und dann gefestigt werden. Lernende erwerben Prozesswissen, indem sie modellierte Beispiele studieren, in gelenkten Übungen selbst anwenden und mithilfe von „worked examples“ sowie Fehleranalysen Schritt für Schritt ihre Vorgehensweisen optimieren. Festigen können Lernende dieses Prozesswissen besonders gut durch Interaktion oder Wettbewerb mit anderen Lernenden, da diese Auseinandersetzung ihnen dabei hilft, verschiedene Nutzungskontexte zu vergleichen (Chi et al., 2018).

Die höchste Stufe nennt Hattie „knowing with“: Wissen wird flexibel auf neue Situationen übertragen. Problembasiertes Lernen, authentische Fallstudien, bewusste Reflexionsphasen und kooperativ angelegte Projekte helfen dabei, Konzepte in unbekannten Kontexten sicher anzuwenden und weiterzuentwickeln.

Wo können wir neue technische Hilfsmittel wie LLMs zur Unterstützung dieser Methoden besonders effektiv einsetzen?

| Kategorie | Phase | Typische Methoden |

|---|---|---|

| Wissen, dass („Knowing that“) | Erwerben | Notizen zusammenführen; Zusammenfassen; Heft-/Notizbuch-Durchsicht; Bildhafte Notizen |

| Wissen, dass („Knowing that“) | Festigen | Argumente prüfen; Fehler identifizieren; Einschränkungen formulieren; Formale Argumentstrukturen darstellen; Belege liefern; Durchgearbeitete Beispiele |

| Wissen, wie („Knowing how“) | Erwerben | Aufgabenüberarbeitung; Häufiges Üben; Übungseinheit vor Tests; Zweispaltige Notizen; Problemorientiertes Lernen |

| Wissen, wie („Knowing how“) | Festigen | Peer-Feedback / Peer-Response-Gruppen; Peer-Tutoring; Studierenden-Turniere; Think-Pair-Share; Kumulative Wiederholung |

| Wissen anwenden („Knowing with“) | Transfer | Sortieren, Zuordnen, Kategorisieren; Dichotome Schlüssel; Von Studierenden erstellte Klassifikationsmuster; Klassifikationsdiagramme |

3.3 Anwendungsbeispiele nach Wissenskategorien

Zur Unterstützung des Aufbaus von Faktenwissen („knowing that“) können neuere LLMs inzwischen gut grundlegende Konzepte erklären (Korinek, 2024, S.48) und zum Selbststudium komplette Abruf-Übungen erzeugen: Sie formulieren Multiple-Choice- und Kurzantwortfragen, bewerten die Eingaben sofort und erklären fehlerhafte Distraktoren – ein Verfahren, das in einer STEM-Untersuchung zur automatischen Item-Generierung überzeugende Validitätswerte zeigte (Säuberli & Clematide, 2024).

Ebenso lassen sich sehr schnell Definitionen, Paraphrasen oder Mini-Zusammenfassungen erzeugen, was personalisierte Glossare ermöglicht (Chen et al., 2024). Wang et al. (2024) sprechen von KI als „Confusion Helper“. Um Halluzinationen zu vermeiden, wird das Modell häufig per Retrieval-Augmentation an externe Wissensbasen gekoppelt (also z. B. durch Beigabe von Skripten oder Fachartikeln als PDF. Siehe auch das Harvard-Tutor-Bot Beispiel in Abschnitt 4.3, wo Musterlösungen beigegeben werden.).

Zur Festigung von Prozessen und Strategien („knowing how“) dient das LLM als dialogischer Coach: Feingranulierte Prompts („Erkläre den Beschaffungsprozess in 5 Schritten und stelle nach jeder Stufe eine Kontrollfrage“) steigern die Lösungswahrscheinlichkeit in Tutorendialogen (Scarlatos et al., 2025). Sprachmodelle können Lehrenden dabei helfen, komplette „worked examples“ mitsamt Zwischenschritten zu generieren (Hassany et al., 2024).

Angepasste Sprachmodelle können Lernende zur Selbstkorrektur anleiten. Umso besser geht das, wenn das Sprachmodell fachspezifische Lerntheorien kennen (z.B.: typische Englischfehler von Deutschen oder typische Verhaltensfehler bei Verhandlungen oder beim Feedback-Gespräch im sozialen Bereich) und die individuelle Lernhistorie - sie also wissen, in welche Fallen ich als Lernender gerne tappe. Zhang et al. (2025) demonstrieren dies am Beispiel eines selbst entwickelten multimodalen Mathematik-Tutor-Bots (MathCCS, Mathematical Classification and Constructive Suggestions).

Der Teachable-Agent-Ansatz nutzt umgekehrt das Lernen-durch-Lehren-Prinzip: Studierende bringen dem LLM eine Methode bei und reflektieren dabei ihre eigene Strategie. Dies basiert auf der Annahme, dass Interaktionen besonders effektiv zum Lernen beitragen (Chi et al., 2018; Hayashi et al., 2025). Wie auch in der persönlichen Interaktion scheint hierbei wichtig zu sein, welche „Persönlichkeit“ der KI-Bot hat, dem Studierende etwas beibringen sollen (Lyu et al., 2025) und mehr Anstrengung in der Interaktion (etwa durch ausführlicheres Formulieren beim Erklären) führt zu mehr Lernerfolg (Love et al., 2025).

Sprachmodelle können genutzt werden, um komplexe (mathematische) Anwendungsprobleme mit einem simulierten User „durchzuspielen“, so dass logische Fehler im Lösungsprozess sichtbar werden, wie der Prototyp „MathChat“ von Y. Wu et al. (2023) zeigt. Meta-Analysen zeigen starke positive Lerneffekte, deuten aber auch auf mögliche Einschränkungen hin. So gibt es Anzeichen dafür, dass die Effekte höher für Studierende sind als für Schüler und möglicherweise schwinden Motivationsschübe durch abnehmende ‘novelty effects’ einfacher Chat-Interfaces über die Zeit der Nutzung. Die Autoren der Metastudie empfehlen, hier mit stärkerer Gamifizierung und Personalisierung der Chatbots gegenzusteuern (R. Wu & Yu, 2024), was sich mit praktischen Ansätzen etwa von Duolingo deckt (Kazu & Kuvvetli, 2025) (z. B. Gamifizierung durch Streaks und Leaderboards, Challenges, Video-Chats mit dem Emo-Teen Lili usw.). Solche aufwändigen Setups sind im Hochschulkontext natürlich schwieriger abzudecken, ließen sich aber vielleicht graduell als Studierendenprojekt entwickeln?

Für Transfer und Anwendung („knowing with“) entwirft das LLM realitätsnahe Szenarien – etwa Rollenspiele zu Lieferantenausfällen – und übernimmt Stakeholder-Rollen, wobei Analysen des Brookings-Instituts das Potenzial für kollaboratives Reasoning hervorheben (Korinek, 2024). Cross-Domain-Prompts fördern Analogiebildung („Welche Parallelen bestehen zwischen agilem Projektmanagement und Lean-Procurement?“) (Mollick & Mollick, 2023).

In Gruppenarbeiten funktioniert das Modell als Co-Autor: KI-unterstützte Schreibprozesse können die Menge und Vielfalt der Ideen steigern (Meincke et al., 2024; Shaer et al., 2024). Auch hier ist jedoch die sorgfältige Gestaltung des Lernprozesses wichtig, so dass nicht erwünschte Schwierigkeiten an die KI delegiert und so kritische Denkprozesse nicht eingeübt werden (Lee et al., 2025).

3.4 Effektive Lerntechniken und Unterstützung mit KI

3.4.1 Wie lernen wir besonders effektiv?

In diesem Abschnitt verdeutlichen wir kurz die angestrebten Wirkmechanismen mit Fokus auf drei Lehrtechniken, die die Kognitionswissenschaft als besonders effektiv heraushebt (siehe Mörth et al. (2021) für eine gute deutschsprachige Übersicht).

Die moderne Lernforschung der Kognitionspsychologie stellt drei Gruppen von Techniken als besonders gute Kombination zwischen Effektivität und einfacher Anwendung heraus: Verteiltes und gemischtes Lernen, testgestütztes Lernen und fragebasierte Ausarbeitung (Dunlosky et al., 2013; Mörth et al., 2021; Roediger & Pyc, 2012). Diese Wirkung gibt es allerdings nicht umsonst: Den positiven Effekten der Techniken steht oft ein deutlich höherer Vorbereitungsaufwand gegenüber. Wie im Folgenden kurz skizziert wird, lassen sich KI-Tools nutzen, um den Aufwand dieser drei Mechanismen zu verringern, was die Lernwirkung im Vergleich zu traditionellen Ansätzen deutlich erhöhen kann.

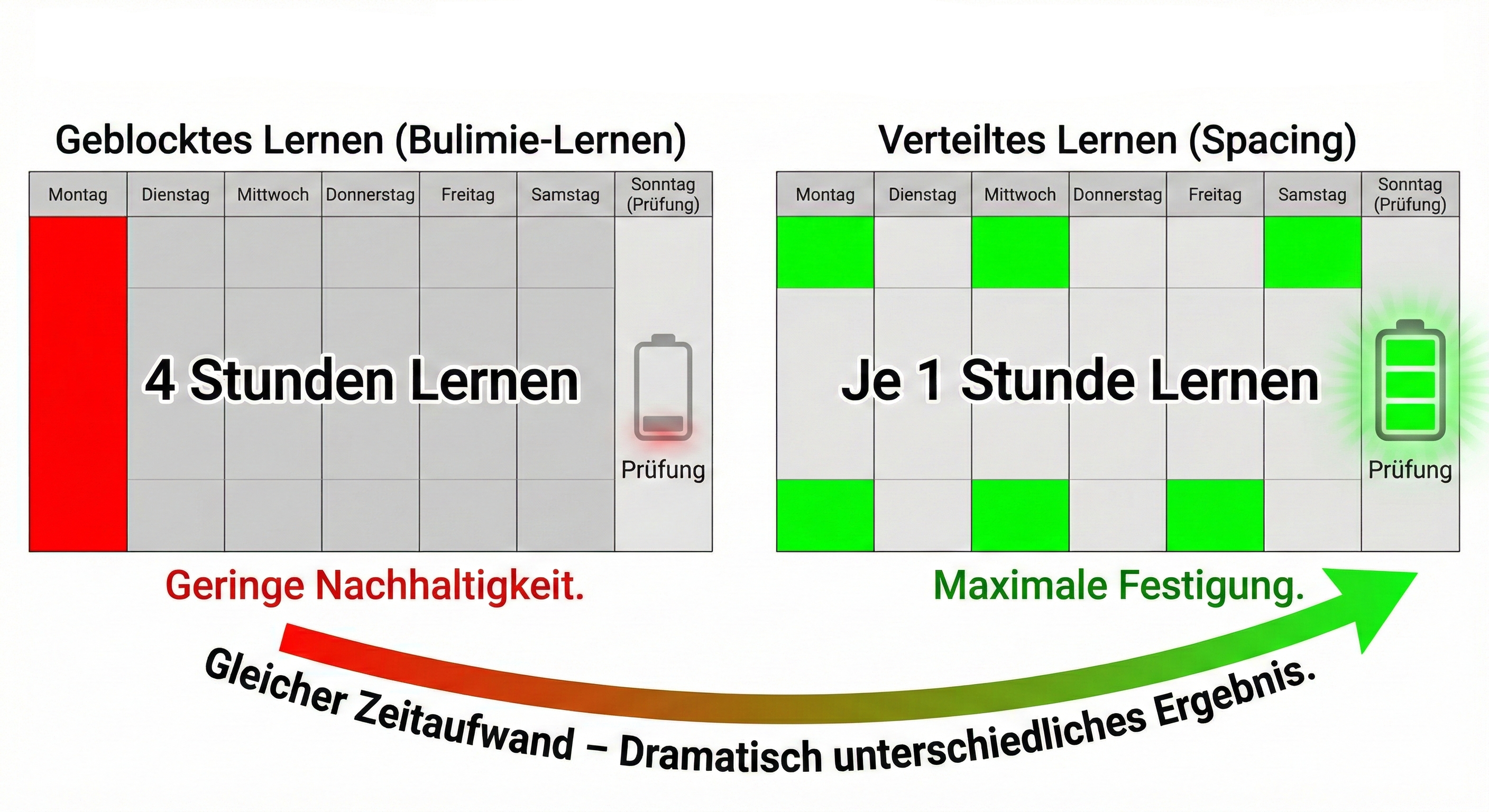

Zeitliche Verteilung und inhaltliche Mischung von Lerninhalten (Spacing & interleaving): Diese Technik basiert auf dem Prinzip, dass Informationen besser behalten werden, wenn das Lernen über die Zeit verteilt und in verschiedenen Kontexten stattfindet, anstatt in einer einzigen, intensiven Sitzung (Brown et al., 2014; Murre & Dros, 2015; Roediger & Pyc, 2012).

Abstände zwischen Lerneinheiten und die wiederholte Aktivierung von Wissensstrukturen stärken die Verbindung zwischen Hinweisreizen und Gedächtnis und geben dem Gehirn Zeit, Erinnerungen effektiv zu speichern. Dies fördert die Langzeiterinnerung, denn der wiederholte Abruf verstärkt die gespeicherten Muster und vertieft sie so.

Quelle: Erstellt mit Gemini3, basierend auf Roediger & Pyc (2012).

Weiterhin hilft es, zu „mischen“: inhaltlich gemischtes Üben (interleaving) ist effektiver als die isolierte Behandlung von Themenblöcken, die linear im Semesterverlauf abgehandelt werden (Mörth et al., 2021). Das liegt daran, dass das gemischte Üben die Unterscheidung zwischen verschiedenen Aufgabentypen fördert, was entscheidend für die spätere Anwendungskompetenz ist. Nur durch den geübten Vergleich verschiedener Kombinationen von Anwendungskontexten und Lösungsansätzen kann ein Gefühl dafür ausgebildet werden, welches Werkzeug zu welchem Problem passt. Fallstudien und Simulationen bieten sich hier an, wenn diese ausreichend komplex sind, um bekannte Analysen in neuen Kontexten anzuwenden und neue einzuführen.

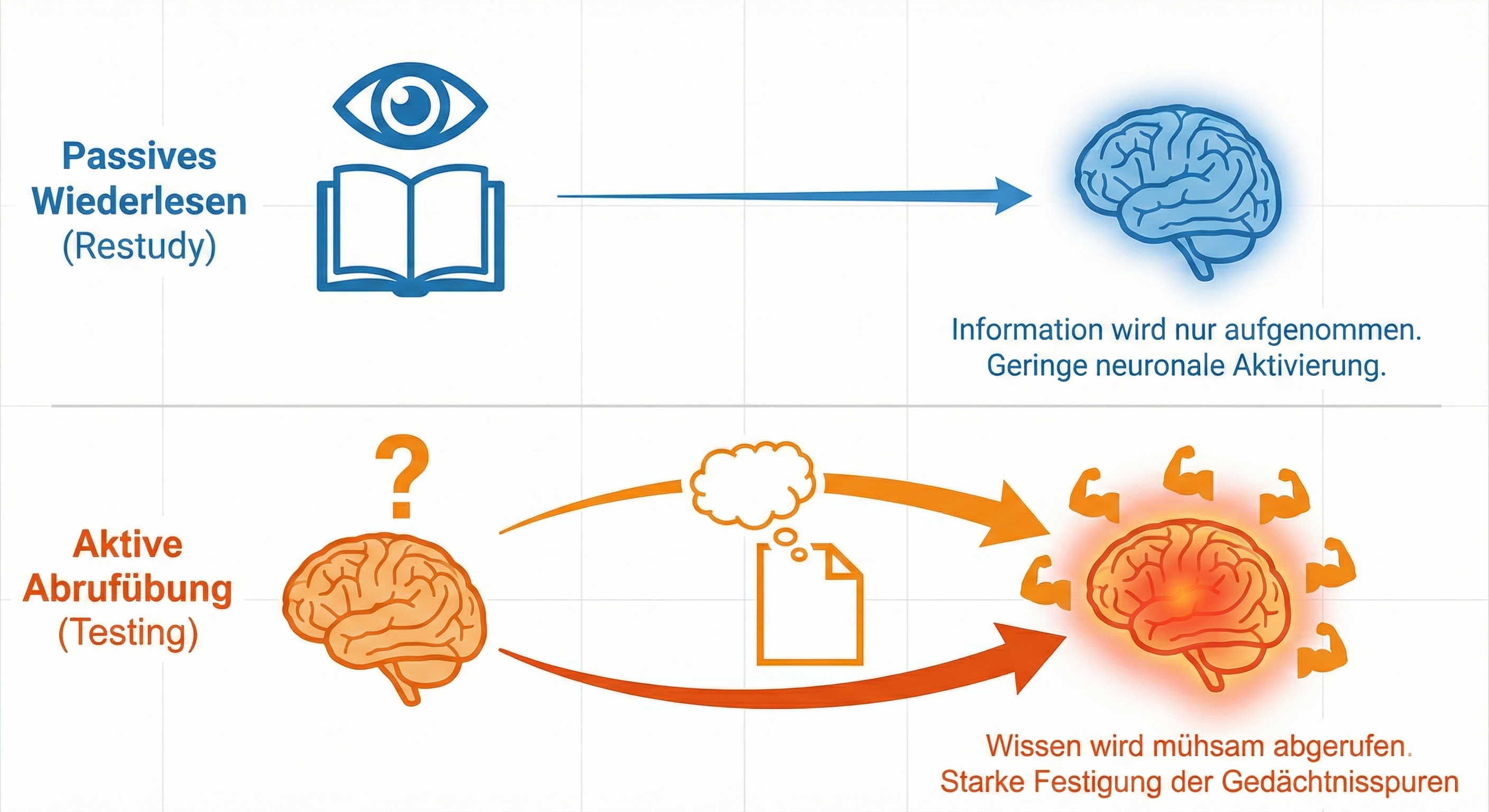

Testgestütztes Lernen (Test-enhanced learning): Das Abrufen von Informationen durch Tests fördert das Langzeitgedächtnis deutlich stärker als das erneute Lesen des Stoffes. Für Studierende ist das anstrengender, es bringt aber deutlich mehr (Brown et al., 2014). Ein ‚Test‘ kann dabei auch die Bearbeitung von Lerninhalten im Rahmen einer Fallstudie, die kritische Bewertung potenziell falscher Aussagen eines LLMs oder die Beantwortung von Verständnisfragen im Dialog mit einem Tutor-Bot sein.

Quelle: Erstellt mit Gemini3, basierend auf Roediger & Pyc (2012).

Häufige Aktivierung von Lerninhalten durch Fragen verbessert den Lernerfolg durch mehrere Mechanismen (Roediger & Karpicke, 2006). Erstens fördert solches Testen das transfergerechte Verarbeiten, da die mentalen Prozesse beim Testen und beim späteren Abrufen ähnlich sind, was die Erinnerungsfähigkeit verbessert. Zweitens stärkt die Wiederholung durch Tests einerseits den erinnerten Inhalt und fügt andererseits neue ‚Haken‘ hinzu, mit denen wir den Inhalt aus dem Gedächtnis ziehen: die Beziehungen zwischen Hinweisreizen (cues) und dem Inhalt im Gedächtnis, indem zusätzliche Abrufwege zu gespeicherten Wissensmustern geschaffen werden, was den Abruf verbessert. Praktisch kann man diesen tollen Effekt auch recht einfach durch regelmäßige kurze Fragerunden nutzen: Wie die Lernforscher herausstellen: „frequent low-stakes quizzes (last only 5 or 10 min) can produce a large boost in performance“ (Roediger & Pyc, 2012, S.246).

Fragebasierte Ausarbeitung (Explanatory questioning): Bei dieser Technik wird das tiefergehende Verständnis von Material durch das Stellen und Beantworten von „Warum“-Fragen gefördert. In Rollenspielen und Simulationen können Teilnehmer durch bewusste Praxis aktiv Szenarien durchspielen, während sie gleichzeitig durch gezielte Fragen angeleitet werden, die zum tieferen Nachdenken und zur Reflexion anregen. Diese Fragen können dazu dienen, die Teilnehmer dazu zu bringen, ihre Entscheidungen und Handlungen im Kontext des Rollenspiels zu erklären, wodurch das Verständnis für die Anwendung von Konzepten in realen oder simulierten Situationen vertieft wird.

Indem Lernende über die Gründe hinter den Fakten nachdenken, werden Verbindungen zu bereits bekanntem Wissen hergestellt, was zu einem tieferen Verständnis und besserer Erinnerung führt. Dies deckt sich mit dem Postulat der ICAP-Theorie des kognitiven Engagements (Chi et al., 2018): Interaktion (I) ist effektiver als individuelle Konstruktion, was wiederum effektiver ist als aktive (aber nicht konstruktive) Beteiligung, was wiederum die passive Lernteilnahme schlägt (I > C > A > P).

3.4.2 Wie können LLMs genutzt werden, um diese Lerntechniken zu unterstützen?

Wir skizzieren das hier kurz an einem Seminar zum interkulturellen Management. Um zeitliche Verteilung und Mischung zu fördern, kann mit LLMs eine Serie von kurzen, thematisch variierenden Aufgaben und Fallstudien über das Semester verteilt erstellt werden. Diese könnten reale Szenarien abbilden, in denen Studierende ihre Fähigkeiten im interkulturellen Management anwenden müssen. Beispielsweise könnte das Sprachmodell Aufgaben generieren, bei denen Studierende Strategien für die Überwindung kultureller Barrieren in internationalen Teams entwickeln.

Was sind Beispiele für testgestütztes Lernen? Regelmäßige, durch LLMs generierte Quizze bringen Studierende dazu, ihr Wissen häufiger aktiv abzurufen. Durch LLMs können Multiple-Choice-Fragen, Fallstudienanalysen und Szenariobeschreibungen zu interkulturellen Missverständnissen erzeugt werden, welche die Studierenden lösen müssen.

Zur Unterstützung von fragebasierter Ausarbeitung können LLMs die Erstellung von Fallstudien, Simulationen und Rollenspielen unterstützen, damit Studierende über interkulturelle Dynamiken und Managementstrategien nachdenken. Diese könnten als Ausgangspunkt für Diskussionen im Kurs oder als Teil von Hausaufgaben dienen, wobei die Studierenden angehalten werden, über die Verbindungen zwischen dem Kursmaterial und den simulierten interkulturellen Interaktionen zu reflektieren. Viele weitere Beispiele hierfür besprechen wir im folgenden Kapitel, wo wir Anwendungsfälle von KI in der Lehre nach der didaktischen Rolle des Werkzeugs darstellen: Hilfskraft, Copilot, Tutor oder Simulator.